La batalla por la supremacía en la inteligencia artificial generativa ha entrado en una nueva y fascinante fase. Lo que comenzó como un duelo entre dos modelos de lenguaje, con ChatGPT de OpenAI liderando claramente la carrera, se ha transformado en un combate a tres bandas donde la innovación y la especialización son las nuevas armas. Google, tras un inicio titubeante con Bard, ha redoblado sus esfuerzos y lanzado **Gemini Advanced**, un contendiente que no solo iguala, sino que en ciertos aspectos supera a su rival. La respuesta de OpenAI no se ha hecho esperar, y ha sido contundente: han integrado capacidades de análisis de datos multimodales directamente en ChatGPT, convirtiéndolo, entre otras cosas, en un asistente médico de bolsillo. Este movimiento redefine por completo lo que podemos esperar de estos asistentes.

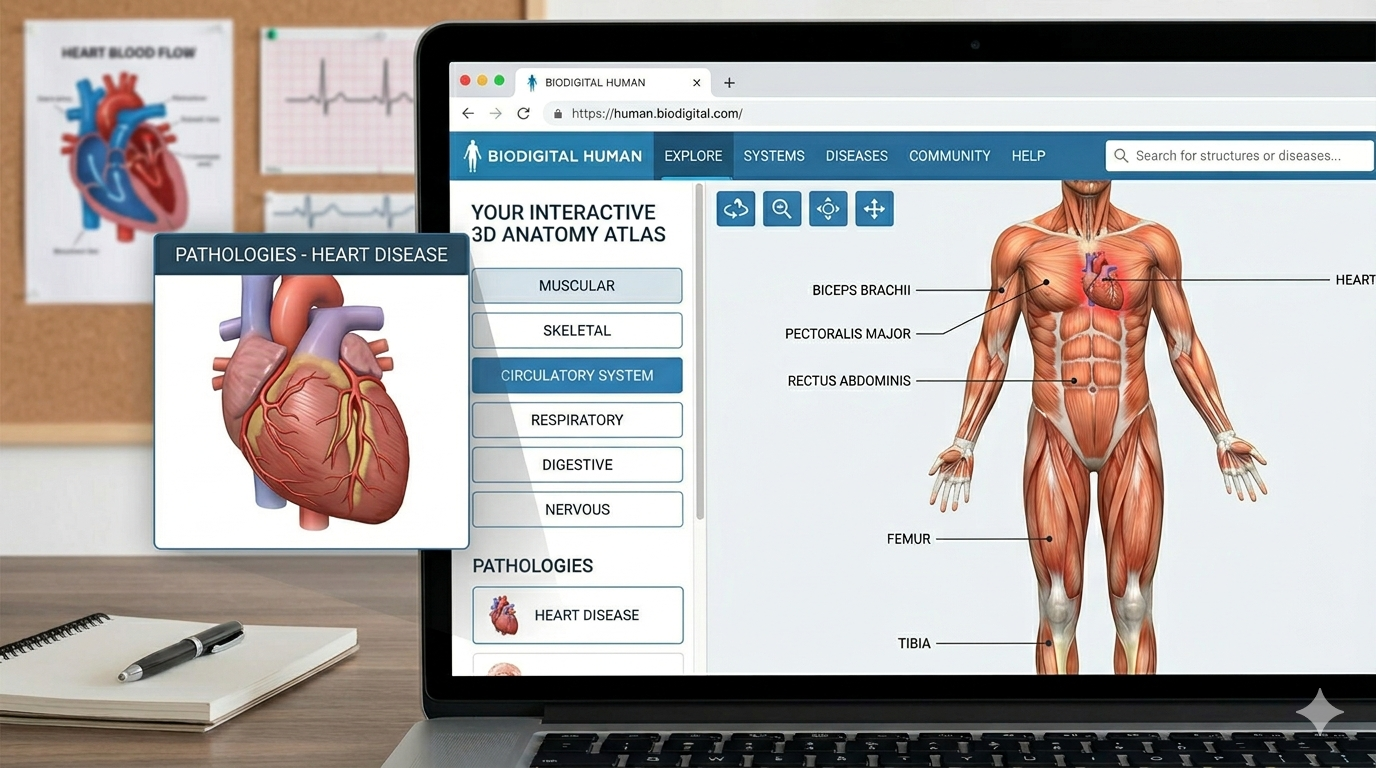

Estamos dejando atrás la era de los chatbots que solo generaban texto convincente. Ahora, los modelos están evolucionando hacia **asistentes multifuncionales integrales** que pueden ver, escuchar, entender y razonar sobre el mundo que los rodea a través de diferentes tipos de datos. La integración de la visión por computadora y el análisis de archivos no es un añadido superficial; es una mejora fundamental que acerca estas herramientas a la promesa original de la IA: ser una extensión de nuestras propias capacidades cognitivas. El usuario ya no solo conversa; colabora con un agente que puede examinar documentos, interpretar imágenes y ofrecer insights basados en un contexto mucho más rico.

##La revolución multimodal: cuando la IA puede ver y entender

El gran salto cualitativo en los últimos meses ha sido la transición de modelos puramente textuales a modelos **multimodales nativos**. Esto significa que la arquitectura fundamental de la IA está diseñada desde su base para procesar y comprender diferentes modalidades de información —texto, imágenes, audio, vídeo— de forma conjunta, no como piezas separadas. Gemini de Google se anunció con esta capacidad como su pilar fundamental, y OpenAI, aunque inicialmente se centró en el texto con GPT-4, ha respondido integrando estas funcionalidades de manera profunda en la experiencia de usuario de ChatGPT.

Esta multimodalidad es un cambio de juego por varias razones. En primer lugar, **elimina barreras de entrada**. Un usuario puede ahora subir una foto de la nevera y preguntar: «¿Qué puedo cocinar con estos ingredientes?». Puede capturar una gráfica compleja de un informe y pedir: «Explícame los datos clave de este gráfico». O, como veremos, puede mostrar una erupción cutánea y buscar una orientación preliminar. La IA ya no requiere que el usuario traduzca el mundo visual a descripciones textuales; lo interpreta por sí misma.

En segundo lugar, potencia enormemente la **productividad y la creatividad**. Imagina a un estudiante que sube sus apuntes escritos a mano y le pide al modelo que los resuma, los organice en un esquema y genere tarjetas de estudio. O a un profesional del marketing que analiza simultáneamente el texto de un anuncio, su composición visual y el rendimiento en datos de una hoja de cálculo, todo en una misma conversación. La capacidad de cruzar tipos de datos permite conexiones y análisis que antes eran imposibles o requerían múltiples herramientas especializadas.

###Cómo ChatGPT está implementando la visión artificial

OpenAI no ha lanzado un nuevo modelo desde cero para competir con Gemini en multimodalidad. En su lugar, ha optado por una estrategia inteligente: **integrar capacidades de visión y análisis de documentos directamente en la interfaz y la experiencia de ChatGPT**. Cuando un usuario sube un archivo —ya sea una imagen, un PDF, un documento de Word o una presentación— el modelo puede acceder a su contenido y razonar sobre él.

La magia está en que esto no es un simple OCR (reconocimiento óptico de caracteres). El modelo **comprende el contexto y la semántica** de lo que ve. Por ejemplo, si subes una foto de un armario desordenado, no solo listará los objetos que identifica («camisa azul», «libro», «zapatilla»).